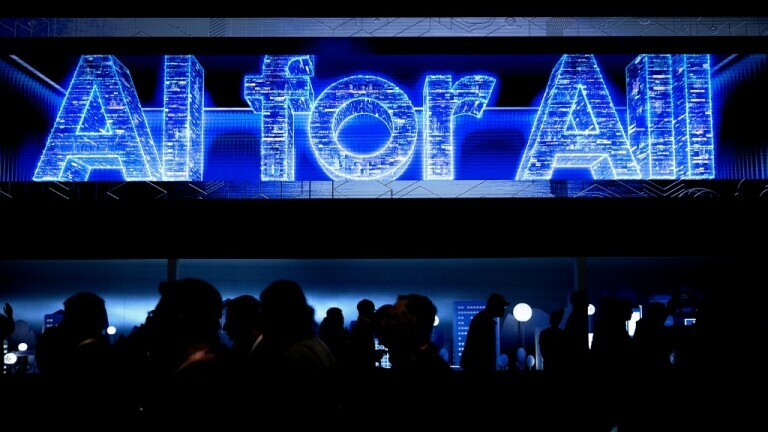

Kad su u Googleu predstavljali svoj veliki jezični model, prvotno nazvan Bard, a potom Gemini, najavili su da će ta umjetna inteligencija u potpunosti promijeniti način na koji koristimo internet.

Iako su napočetku imali nekih problema s točnošću informacija koje je Bard odnosno Gemini isporučivao korisnicima, Google je bio odlučan uvesti umjetnu inteligenciju u što više svojih "proizvoda".

No, čini se da uvođenje umjetne inteligencije u baš sve Googleove proizvode, među ostalim i u onaj najpoznatiji, tražilicu na internetu, nije baš rezultirao poboljšanjima kojima su se u Googleu nadali.

Naime, njihovi su istraživači objavili novi dokument koji upozorava da generativna umjetna inteligencija, poput ChatGPT-a ili Geminija, uništava goleme dijelove interneta lažnim sadržajem. Ironično, zar ne?

Studija, koja još čeka recenziju, ističe kako je velika većina korisnika generativne umjetne inteligencije iskoristila tu tehnologiju kako bi stvorila lažni sadržaj i plasirala ga na internet.

Manipulacija ljudskom sličnošću i krivotvorenje dokaza najraširenije su tehnike u stvarnim slučajevima zlouporabe. Većina njih bila je korištena s vidljivom namjerom da utječu na javno mnijenje, omoguće prijevare, lažne aktivnosti ili generiraju profit, navode istraživači u svojoj studiji.

Problem je sve kompleksniji što su sustavi generativne umjetne inteligencije napredniji i jednostavniji za korištenje. Takva situacija, ističu istraživači, "izokreće ljudsko kolektivno razumijevanje socio-političke stvarnosti ili znanstvenog konsenzusa".

Dakle, činjenica da generativna umjetna inteligencija predobro odrađuje svoj posao i stvara uvjerljiv lažni sadržaj te time preplavljuje internet, sad je odjednom prostao problem. I to problem koji su stvorili sami korisnici, zahvaljujući velikim IT tvrtkama koje su im servirale alat za stvaranje takvog sadržaja i poticali ih da ga koriste.

No, istraživači u svojoj studiji upozoravaju i kako ovaj nered na internetu sad testira sposobnost ljudi da razlikuju lažno i stvarno.

Masovna proizvodnja niskokvalitetnog, neželjenog sintetičkog sadržaja riskira povećanje skepticizma ljudi prema digitalnim informacijama u cjelini te opterećuje korisnike koji sad te informacije moraju dodatno provjeravati, pišu istraživači.

Također, dodaju, bilo je slučajeva kad su pojedinci, nesintetičke informacije koje im nisu odgovarale, označavali kao generirane pomoću umjetne inteligencije, čime su dodatno unijeli konfuziju.

Čini se kako je ona uzrečica da sve treba uzimati sa "zrnom soli" odnosno dozom skepse, u današnje vrijeme široke upotrebe generativne umjetne inteligencije, sve aktualnija. No, s obzirom na količinu sintetičkog sadržaja koji nastaje, umjesto onog "zrna" uskoro će nam trebati cijeli rudnik ili solana.

Izvor: 404Media