U nastojanju da se suprotstave rastućoj prijetnji zavaravajućeg izbornog sadržaja generiranog umjetnom inteligencijom, velike tehnološke tvrtke planiraju novi industrijski sporazum. Nacrt Tech Accorda, koji je na uvid dobio list Politico, otkriva inicijativu za suradnju među tvrtkama, uključujući Adobe, Google, Metu, Microsoft, OpenAI i TikTok.

Cilj sporazuma

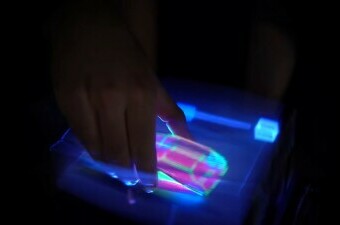

Sporazum ima za cilj razviti alate kao što su vodeni žigovi i tehnike detekcije za prepoznavanje i razotkrivanje "deepfake" sadržaja manipuliranog umjetnom inteligencijom koji uključuje javne osobe. Nacrt sporazuma naglašava zajedničku odgovornost očuvanja izbornog integriteta i javnog povjerenja, nadilazeći stranačke interese i nacionalne granice.

Tehnološke tvrtke namjeravaju otkriti finalizirane detalje na sigurnosnoj konferenciji u Münchenu, baveći se ključnim izazovima koje postavlja umjetna inteligencija na nadolazećim globalnim izborima. Zajednička izjava kompanija naglašava njihovu predanost borbi protiv prijevarne upotrebe umjetne inteligencije usmjerene na birače.

Sve veća zabrinutost oko utjecaja AI-ja na svjetska gospodarstva

Nedavno izvješće sigurnosne konferencije u Münchenu naglašava značajan porast zabrinutosti oko umjetne inteligencije u velikim svjetskim gospodarstvima tijekom 2023. godine, s posebnom pozornošću u Italiji, Francuskoj i Brazilu.

Vlade, uključujući Europsku uniju, rade pritisak na tehnološke tvrtke da se pozabave problemom deepfakeova i obmanjujućeg sadržaja generiranog umjetnom inteligencijom. OpenAI i Meta, među ostalima, obećali su označiti deepfakeove u nadolazećim mjesecima.

Nema "zlatnog" rješenja

Predloženi Zakon o umjetnoj inteligenciji Europske unije nalaže jasno označavanje svih sadržaja generiranih umjetnom inteligencijom, dok Zakon o digitalnim uslugama ima za cilj prisiliti tehnološku industriju da se bori protiv deepfakeova.

Nacrt sporazuma predlaže ideje kao što su razvoj "tehnologije detekcije" i uspostavljanje "identifikatora temeljenih na otvorenim standardima" za duboko lažni sadržaj koristeći postojeće inicijative kao što su C2PA i SynthID. Međutim, nacrt sporazuma priznaje da tehnički alati sami po sebi ne mogu u potpunosti ublažiti rizike umjetne inteligencije i naglašava potrebu za potporom vlade i organizacija za podizanje svijesti javnosti o deepfakeovima.

Kritike sporazuma

Kritičari unutar tehnološke industrije, uključujući Meredith Whittaker iz Instituta AI Now, tvrde da bi inicijativa mogla odvratiti pozornost od reguliranja i nadzora nad tehnološkim tvrtkama. Whittaker tvrdi da je rješavanje širenja deepfakeova na platformama društvenih medija i putem modela oglašavanja ključno te dovodi u pitanje učinkovitost samoregulacije tvrtki.